Die Gerüchte rund um Apples AI-Pläne mehren sich. Dazu gehört auch die zukünftige Hardware des Unternehmens. Einen Aspekt der Meldungen haben die Berichte aber gemein: Der iPhone-Hersteller will unter anderem mithilfe von Kameras Eure Umgebung besser verstehen. So ist etwa die Rede von einem Anhänger und AirPods mit integrierter Kamera. Hinzu kommen angebliche Smart Glasses, die nicht nur Fotos und Videos aufnehmen können, sondern zusätzlich Eure Umgebung analysieren. Das alles soll dabei helfen, Euch bessere Antworten auf etwaige Fragen geben zu können.

Dank Sensoren, die unter anderem Distanzen messen können, kann eine Navigations-App präzisere Angaben machen. Ein besseres Verständnis der Umgebung könnte dafür sorgen, dass Ihr Anweisungen wie „an der pinken Litfaßsäule in 20 Metern bitte links abbiegen“ bekommt.

Was ist Apples Visual Intelligence?

Das alles ist aktuell noch Zukunftsmusik. Schon heute könnt Ihr jedoch erste Vorboten dieser Technik selbst auf dem iPhone ausprobieren. Seit iOS 18 ist Visual Intelligence Teil des Smartphones. Mittlerweile ist die Funktion auch in Deutschland verfügbar.

Voraussetzung ist ein iPhone, das mit Apple Intelligence kompatibel ist und diese AI-Funktionen auch in den Einstellungen aktiviert sind. Ihr braucht also ein iPhone 15 Pro oder neuer. Bei aktuellen Smartphone-Modellen wird Visual Intelligence über einen langen Druck der Kamerasteuerung aktiviert. Auf Geräten ohne diese Seitentaste, müsst Ihr es über das Kontrollzentrum oder den Action Button öffnen.

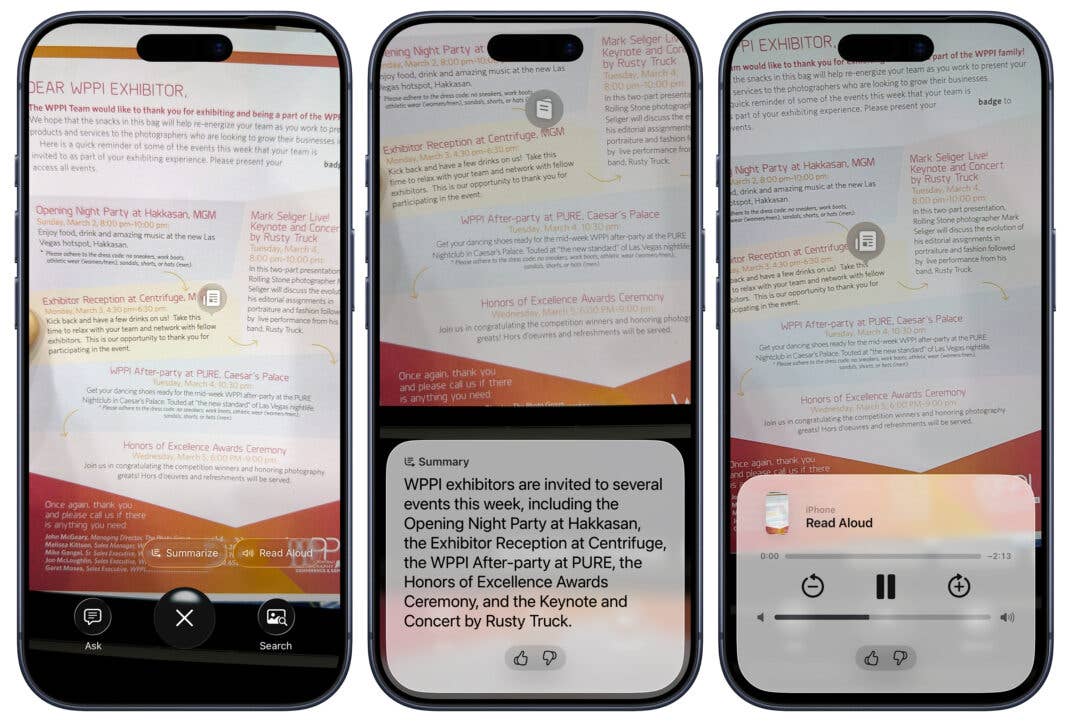

Nach der Aktivierung von Visual Intelligence seht Ihr zunächst eine bunte Animation, die an Siri erinnert, gefolgt von einer Kamerasicht mit drei Bedienelementen: „Fragen“, einem Auslöser für die Kamera und ein „Suchen“-Symbol. Über „Fragen“ könnt Ihr beliebige Fragen zum aufgenommenen Bild an ChatGPT senden. „Suchen“ schickt das Foto an Google, um weitere Informationen zu erhalten. Nach der Aufnahme eines Bildes seht Ihr viele automatische Features, die vom jeweiligen Schnappschuss abhängen.

Eine weitere Möglichkeit zur Aktivierung von Visual Intelligence ist die Aufnahme eines Bildschirmfotos. Hilfreich dann, wenn es um ein bereits aufgenommenes Bild aus der Fotos-App geht oder um Dinge, die Ihr in einer App seht. Bildschirmfotos nehmt Ihr durch gleichzeitiges Drücken der „Lauter“-Taste und Seitentaste auf der anderen Seite des iPhones auf. Auch hier werden Euch je nach Inhalt einige der folgenden Optionen angezeigt.

Details zu einem Event

Ein Beispiel ist das Fotografieren eines Posters, das Ihr unterwegs gesehen habt. Sind auf dem Poster beispielsweise ein Datum und Ort genannt, bietet Euch Visual Intelligence die Möglichkeit zum Anlegen eines Kalendereintrags an.

Werden Telefonnummern oder Webseiten erkannt, könnt Ihr diese ebenfalls direkt per Fingertipp aufrufen. Je nachdem, in welchem Zusammenhang Visual Intelligence Telefonnummern, E-Mail-Adressen oder Postanschriften erkennt, kann Euch das System anbieten, diese in einem Kontakt zu speichern. Erkannte Adressen lassen sich darüber hinaus direkt in der Karten-App öffnen.

Textfunktionen in Visual Intelligence

Wenn Ihr Fotos von längeren Texten macht, bietet Euch Visual Intelligence unter anderem an, den Text mithilfe von AI zusammenzufassen. Hilfreich ist in diesem Zusammenhang auch die Möglichkeit, den Text vom Smartphone laut vorlesen zu lassen. Damit verwandelt sich das Smartphone in eine praktische Bedienungshilfe.

Sofern der Text nicht in Eurer Sprache ist, bietet Euch Visual Intelligence an, diesen zu übersetzen. Die übersetzten Texte erscheinen dann direkt dort, wo die Originaltexte zu sehen waren. Hilfreich zum Beispiel dann, wenn Ihr im Urlaub das Menü im Restaurant nicht versteht.

Sind auf dem Foto QR-Codes zu sehen, werden diese ebenfalls von Visual Intelligence erkannt. Für QR-Codes genügt es aber schon, wenn Ihr diese in der normalen Kamera-App anvisiert.

ChatGPT und Google-Suche

Teil von iOS 18 und iOS 26 ist die bereits angesprochene Integration von ChatGPT als Helfer für viele AI-Anwendungen. Diese sind auch in Visual Intelligence zu finden. Wenn Ihr ein Foto geschossen habt, könnt Ihr durch Tippen der „Fragen“-Option jede erdenkliche Frage zu diesem Bild stellen. Ihr habt ein Restaurant im Sucher? Dann könnt Ihr zum Beispiel nach den angebotenen Speisen oder den Öffnungszeiten fragen.

Wenn Ihr Euren ChatGPT-Login in den Einstellungen mit dem iPhone verknüpft habt, werden diese Anfragen inklusive des Fotos auch in der eigenständigen ChatGPT-App angezeigt.

Die zweite Option ist „Suchen“. Dabei wird das Bild an Google übermittelt, um nach ähnlichen Motiven zu recherchieren. Wenn Ihr mit dem Finger einen bestimmten Bildausschnitt markiert, wird nur dieser Bereich berücksichtigt. Das erinnert stark an die von Android bekannte Funktion „Circle to Search“.