Künstliche Intelligenz ist längst im Alltag vieler Menschen angekommen, doch das Misstrauen hält Schritt. Die TÜV-Studie zeigt deutlich: Die Bedenken sind konkret und richten sich nicht auf futuristische Szenarien, sondern auf Entwicklungen, die längst Realität sind – und möglicherweise tief in unseren politischen Diskurs eingreifen.

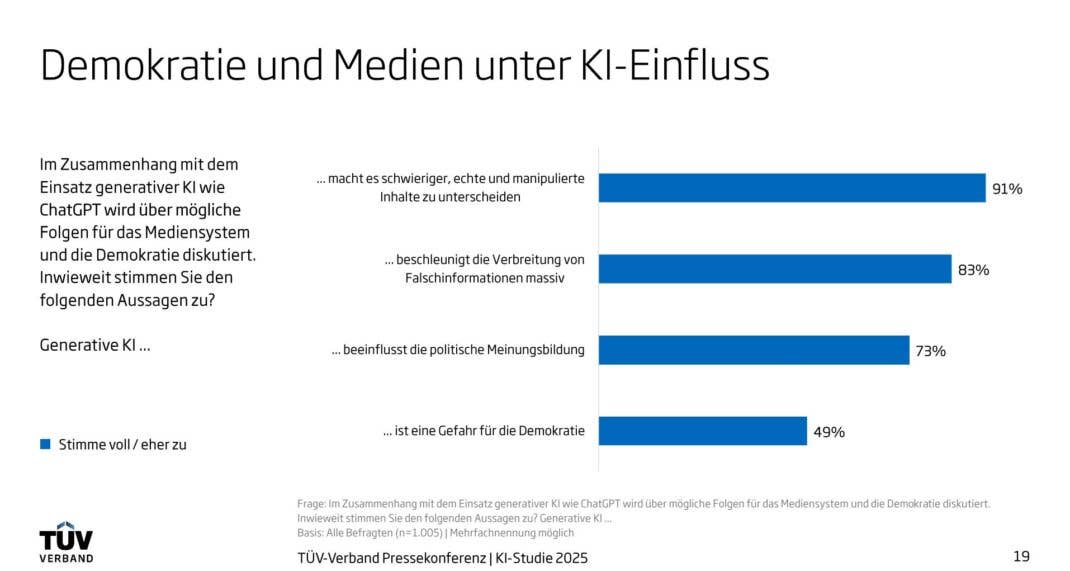

Im Zentrum steht die Angst, nicht mehr sicher unterscheiden zu können, was echt ist und was nicht. 49 Prozent der Befragten sehen generative KI als potenzielles Risiko für die Demokratie. Das hängt vor allem mit der wachsenden Desinformation zusammen: 91 Prozent glauben, dass KI die Unterscheidung von realen und manipulierten Inhalten erschwert. 83 Prozent gehen davon aus, dass Fakes sich schneller verbreiten, und 73 Prozent erwarten spürbare Effekte auf die politische Meinungsbildung.

Erfahrungen im Netz untermauern diese Sorgen. Für viele sind KI-Fakes keine abstrakte Idee, sondern etwas, das ihnen längst begegnet ist: 51 Prozent hatten schon Kontakt mit Deepfakes, und ebenso viele haben KI-generierte Inhalte zunächst für authentisch gehalten. Der Verlust an Vertrauen wiegt besonders schwer, weil KI gleichzeitig immer stärker Teil des Alltags wird – wie der nächste Abschnitt zeigt.

KI-Nutzung in Deutschland: Ein Markt zwischen US-Dominanz und lokalen Erfolgen

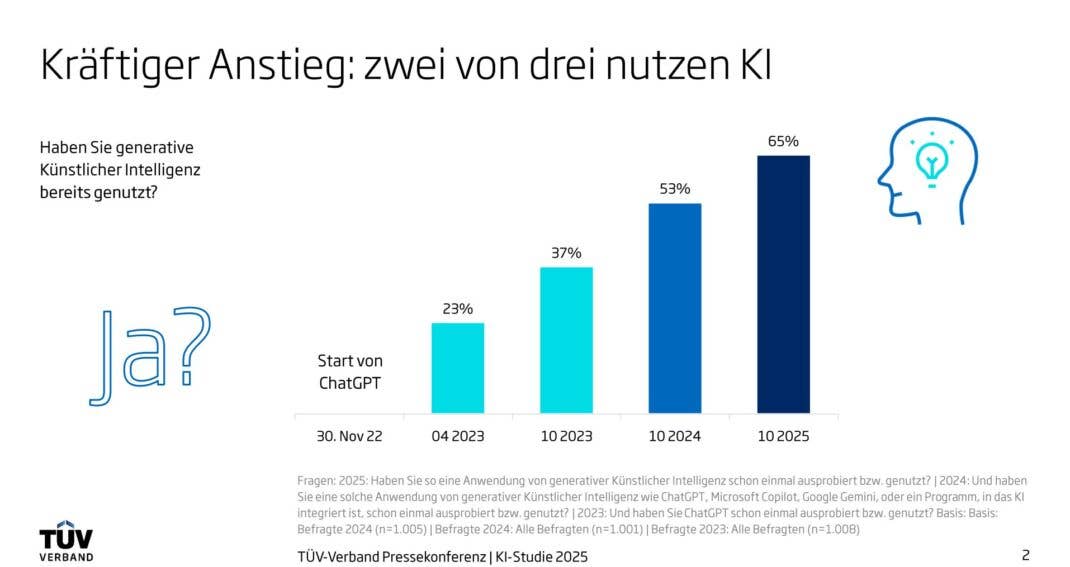

Trotz wachsender Skepsis nimmt der Einsatz von KI-Tools weiter zu. Die Studie zeigt: Die meisten nutzen KI – auch wenn sie ihr nicht blind vertrauen. Praktische Vorteile wie Zeiteinsparung, Übersetzungen oder kreative Unterstützung überwiegen im täglichen Gebrauch oft die grundsätzlichen Vorbehalte. 2024 hatten noch 53 Prozent KI ausprobiert, 2025 sind es bereits 65 Prozent.

Unter jungen Menschen ist KI-Anwendung nahezu selbstverständlich: Neun von zehn unter 29 Jahren nutzen entsprechende Dienste. Auch die Bereitschaft, für KI zu zahlen, wächst: 11 Prozent der Privatnutzerinnen und -nutzer sowie 31 Prozent der beruflichen Anwender greifen bereits zu kostenpflichtigen Angeboten. Der Unterschied zwischen privater und beruflicher Nutzung ist weiterhin groß: 61 Prozent setzen KI privat ein, 32 Prozent beruflich oder im Bildungsumfeld.

Beim Blick auf den Markt dominiert wenig überraschend die US-Konkurrenz. ChatGPT liegt mit Abstand vorn (85 Prozent), gefolgt von Google Gemini (32 Prozent) und Microsoft Copilot (26 Prozent). Dahinter platziert sich überraschend schon das deutsche Unternehmen DeepL mit 20 Prozent – noch vor Meta AI mit 18 Prozent. Europäische ChatGPT-Alternativen sind ansonsten abgeschlagen: Mistrals „Le Chat“ aus Frankreich erreicht lediglich einen Prozentpunkt.

TÜV-Geschäftsführer Joachim Bühler bewertet das Marktgeschehen entsprechend. US-Firmen geben klar die Richtung vor, doch DeepL zeige, dass europäische Anbieter nicht chancenlos sind:

Google macht mit seiner KI-Suche gegenüber ChatGPT Boden gut und Microsoft bleibt mit Copilot im Rennen. Erfreulich aus deutscher Sicht ist, dass sich mit DeepL ein Start-up aus Köln in diesem dynamischen Markt behaupten kann.

Der Ruf nach Regeln: Große Erwartungen, wenig Wissen

Es entsteht ein deutlicher Gegensatz: KI wird immer häufiger genutzt, gleichzeitig bleibt das Misstrauen groß. Viele wünschen sich Orientierung – und klare Leitplanken. Die TÜV-Studie macht deutlich, dass es eine starke Erwartungshaltung an die Politik gibt. Kontrolle, Transparenz und Sicherheit stehen weit oben auf der Wunschliste. Gleichzeitig wissen nur wenige, welche Regeln bereits existieren.

83 Prozent sprechen sich für eine gesetzliche Regulierung von KI aus. 89 Prozent möchten, dass KI-generierte Inhalte eindeutig gekennzeichnet werden. 80 Prozent fordern Prüfungen durch unabhängige Institutionen wie den TÜV.

Doch kaum jemand kennt die wichtigste europäische Regelung: Den EU AI Act haben nur 32 Prozent überhaupt schon einmal gehört. Diese Wissenslücke ist problematisch – denn wer nicht weiß, dass es Schutzmechanismen gibt, bleibt anfällig für Verunsicherung und Misstrauen.

Der TÜV-Verband fordert deshalb eine schnelle Umsetzung der EU-Regeln ins deutsche Recht und eine bessere Erklärung der Vorgaben. Erst wenn klar ist, wie KI überwacht und geprüft wird, kann langfristig Vertrauen entstehen.

Fazit: Klare Erwartungen an eine sichere KI-Zukunft

Die aktuellen Zahlen beschreiben eine Gesellschaft, die KI nutzt, ihr aber noch nicht vertraut. Einerseits wächst die Bedeutung von KI im Alltag – sowohl privat als auch beruflich. Andererseits treiben Themen wie Desinformation, Wahrheit und demokratische Stabilität viele Menschen um.

Für die Politik ergibt sich daraus ein eindeutiger Auftrag: Die Bevölkerung erwartet nicht weniger KI, sondern besser abgesicherte KI. Transparenz, Kontrolle und einfach verständliche Regeln stehen im Mittelpunkt. Der EU AI Act ist dafür ein wichtiges Fundament – jetzt müssen die Maßnahmen umgesetzt und kommuniziert werden.

Erst wenn Vertrauen entsteht, kann KI in Deutschland so eingesetzt werden, wie es viele sich wünschen: sicher, nachvollziehbar und mit echtem gesellschaftlichem Mehrwert. Bis wir da ankommen, könnt Ihr mir ja schon mal verraten: Nutzt Ihr ChatGPT und Co eher privat – oder auch bereits beruflich?