KI verliert Verstand, wenn man sie mit den eigenen Daten trainiert

Das menschengemachte Trainingsmaterial für KIs wird knapp. Doch warum die Systeme nicht mit ihrem eigenen Output füttern? Forscher haben jetzt genau diesen Ansatz untersucht und müssen feststellen: Dann dreht die künstliche Intelligenz schnell einfach durch.

Selbstverzehrende Schleife macht KI "MAD"

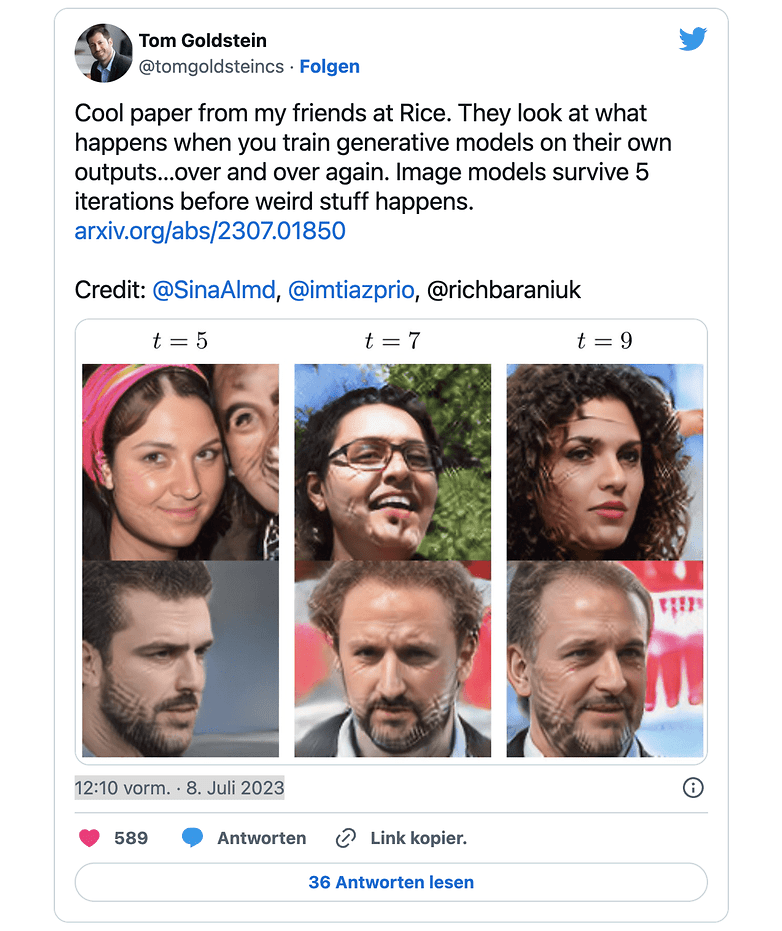

Es ist ein Problem, über das aktuelle viele Experten und Unternehmen nachdenken. KIs, so wie sie aktuell funktionieren, brauchen für ihr Training hochwertiges Material. Laut Forschern ist aber absehbar, dass dieses in den nächsten Jahren erschöpft sein wird. Wie die Wissenschaftler der Universitäten Rice und Stanford in ihrer Studie erläutern, ist ein Ausweg, der in der Branche diskutiert wurde, am Ende wohl nur eine Sackgasse. Wenn man generative KI-Modelle - ob Sprachmodelle oder Bildgeneratoren - mit von KI-erzeugtem Material trainiert, werden die Ergebnisse immer schlechter.

"Die enormen Fortschritte bei generativen KI-Algorithmen für Bilder, Texte und andere Datentypen haben dazu geführt, dass die Versuchung groß ist, synthetische Daten zu verwenden, um Modelle der nächsten Generation zu trainieren", schreiben die Forscher laut Futurism. In ihrer Studie führen solche Versuche aber nur zu einer "selbst verzehrenden Schleife". Die wichtigste Schlussfolgerung: Ohne reale Daten seien zukünftige generative Modelle "dazu verdammt", dass sich ihre Qualität progressiv verringert.

Wie die Forscher erläutern, ist ein Grund für dieses selbstzerstörerische Verhalten die Tendenz der aktuellen KI-Systeme, abgelegene, weniger repräsentierte Informationen am Rande der Trainingsdaten des Modells immer weniger zu gewichten. Diese Annäherung der Daten verstärkt sich so drastisch, dass das System sprichwörtlich in sich zusammenfällt. Die Forscher geben diesem Prozess den Namen "MAD" kurz für Model Autophagy Disorder.

Dabei gibt es große Chancen, dass diese "Krankheit" schon jetzt unbemerkt die nächsten Generationen der Modelle angesteckt hat. Trainings-Daten werden in den allermeisten Fällen im Internet erfasst. Deshalb werden kommende generative KIs auch unweigerlich mit immer mehr Daten trainiert, die von den Vorgänger-Systemen erzeugt wurden.

Zusammenfassung

- KIs benötigen hochwertiges Trainingsmaterial, das in Zukunft knapp werden kann.

- Forscher haben einen Ausweg diskutiert: KI-erzeugte Daten verwenden.

- Studie zeigt: KI-erzeugte Daten führen zu schlechteren Ergebnissen.

- Forscher nennen diesen Prozess "Model Autophagy Disorder".

- Kommende generative KIs werden mit immer mehr KI-erzeugten Daten trainiert.

- Ohne reale Daten sind zukünftige generative Modelle "dazu verdammt", dass sich ihre Qualität verringert.

Hat eine KI einen Verstand? In der Theorie ließe sich darüber streiten, aber heutzutage sicher nicht ;)

Aber der Effekt liegt doch im Grunde auf der Hand. Wie soll eine "KI" (so wie sie im aktuellen Sprachgebrauch verwendet wird) denn anhand von KI-Daten "schlauer" werden? Der zu erwartende Fehleranteil wird ja eher größer. Im besten Fall bleibt er identisch.

Erinnert mich an einen uralten Versuch das gleiche Video immer und immer wieder bis zur Unkenntlichkeit bei YT hoch- herunter und wieder hochzuladen. Ist zwar nix mit "KI", aber immerhin mit einem Algorithmus...

"Das menschengemachte Trainingsmaterial für KIs wird knapp."

Warum sollte das knapp werden? Ist das Internet plötzlich nur noch halb so groß oder wohin soll das menschengemachte Material verschwinden? Vermutlich ist gemeint, dass es immer weniger pur ist, weil es immer stärker mit von KI erzeugtem Material durchsetzt ist, aber das ist etwas anderes. Eine KI mit wahllos aus dem Internet zusammengesuchtem Material zu trainieren halte ich ohnehin für unsinnig, auch jetzt ist das Material da ja schon oftmals frei erfundener Quatsch. Aufgrund der bloßen Menge an Material können Fehler zwar ausgeglichen werden, aber auch das funktioniert nur in einem begrenzten Bereich. Ohnehin sollte das Ziel für künftige KI sein, bessere Ergebnisse als heute zu erzielen, aber mit weitaus weniger Trainingsmaterial. Wenn es zig zehntausende Fotos braucht, um einen Schmetterling zu erkennen, ist es mit der Intelligenz noch nicht so weit her.

Das hat mich zuerst auch gewundert. Allerdings lässt sich KI-Hardware sehr gut skalieren. Große Modelle arbeiten jetzt schon mit mehreren 100 Milliarden Parametern. Wenn es in einigen Jahren in der Größenordnung dutzender Billionen Parameter sein sollten, könnte es womöglich tatsächlich zu wenig verfügbare Daten geben, um derart komplexe Modelle zu trainieren, ohne dass es zu "Overfitting" kommt, das heisst die Modelle lernen die Daten auswendig und generalisieren nicht mehr gut.

So halte ich es für möglich, dass die Komplexität der neuronalen Netze einfach schneller wächst, als die verfügbaren Datenmengen, und dann ist es nur eine Frage der Zeit, wann es zu wenig Trainingsdaten für die hochkomplexen Modelle gibt.

Da in der KI-Thematik sehr viel Fantasie steckt, scheint es auch kein Problem zu sein, die immer höheren Milliardensummen für solche KI-Moloche aufzutreiben. Ob das pure Größenwachstum die Möglichkeiten der Netze allerdings in selben Maß steigen lässt, und ob sich nicht doch mit weniger mehr erreichen lässt, ist allerdings auch umstritten und Thema aktueller Diskussionen.

Interessant in diesem Zusammenhang:

https://www.spektrum.de/news/sprachmodelle-ist-bei-einer-ki-groesser-immer-besser/2120211

Quelle: www.spektrum.de

Naja die Gallerie in meinem Handy, kann problemlos, aus 38.000 Fotos plus die ich auf dem Gerä habe, mir alle Bilder mit Schmetterling, einem Bestimmten Auto oder Gesicht zeigen, das ist nun nicht so das Problem.

Auf Deinem Handy läuft aber auch nur die "Inferenz" der KI ab, also die eigentliche Anwendung, in dem Fall die Erkennung bestimmter Muster in Deinen Bildern. Das ist der einfachere Teil. Trainiert wurde das Netz vermutlich in einem leistungsfähigen Rechenzentrum, und ob dafür nur einige tausend Bilder, oder doch eher dutzende oder sogar hunderte Millionen Bilder verwendet wurden, weiss nur Samsung. Und in dem Fall könnten schon tausende Bilder hauptsächlich Schmetterlingsmotive zeigen. Da dieser Trainingsvorgang nur einmal für sehr viele verkaufte Geräte notwendig ist, lassen sich die Kosten dafür wie andere Fixkosten gut umlegen, bleiben also pro Gerät in einem vernünftigen Rahmen.